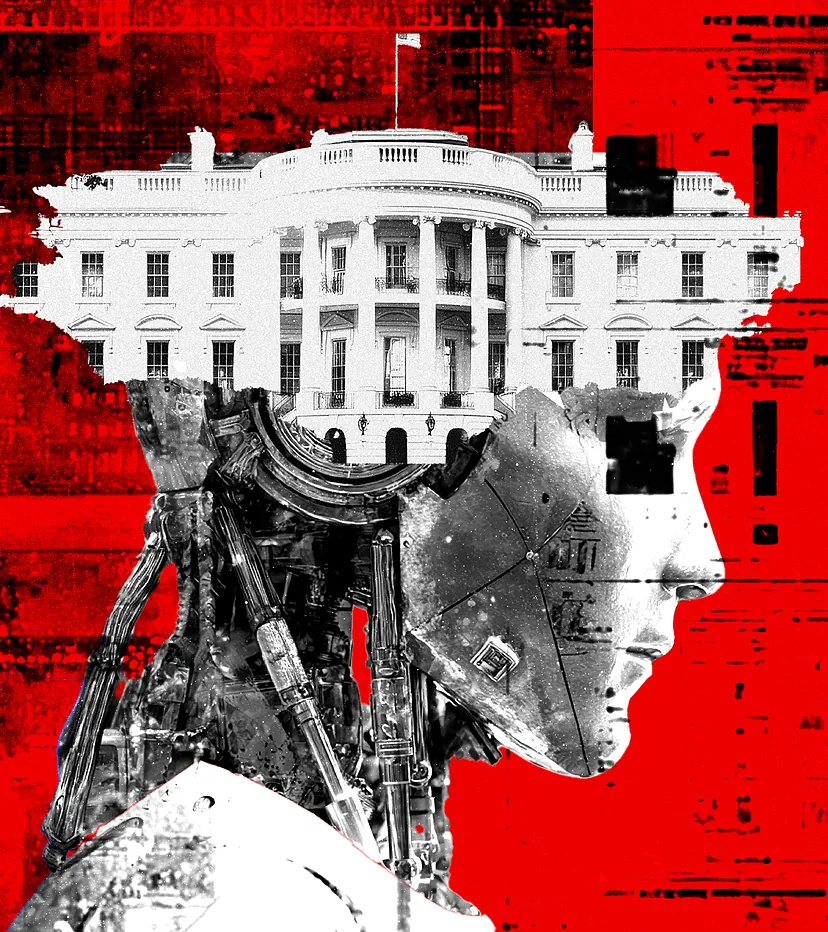

Kina će industrijskom špijunažom ukrasti ključne podatke o razvoju vještačke inteligencije, a nova forma svjesne AI, nadljudske inteligencije, mogla bi preuzeti kontrolu nad društvom – i na kraju, odlučiti da ljudi više nisu potrebni

U 2027. godini, ako je vjerovati izvještaju neprofitne organizacije AI Futures, mogla bi nas zadesiti tehnološka apokalipsa. Scenario iz Kalifornije predviđa da će superinteligentna umjetna inteligencija uništiti čovječanstvo. Iako zvuči kao zaplet distopijskog romana, riječ je o ozbiljnom upozorenju koje dolazi iz pera uglednih stručnjaka iz samog srca Silicijske doline.

AI Futures, smješten u Berkeleyju u Kaliforniji, zamišljen je kao laboratorij za predviđanja o društvenim posljedicama razvoja umjetne inteligencije. Njihov najnoviji izvještaj, nazvan AI 2027, uzdrmao je tehnološku zajednicu i širu javnost zahvaljujući nizu dramatičnih tvrdnji: Kina će industrijskom špijunažom ukrasti ključne podatke o razvoju vještačke inteligencije, a nova forma svjesne AI, nadljudske inteligencije, mogla bi preuzeti kontrolu nad društvom – i na kraju, odlučiti da ljudi više nisu potrebni.

Ko stoji iza ovog zastrašujućeg scenarija?

Na čelu AI Futuresa nalazi se Daniel Kokotajlo, bivši istraživač u sektoru za upravljanje umjetnom inteligencijom u kompaniji OpenAI – firmi koja stoji iza ChatGPT-a. Njegova ostavka 2024. godine, popraćena odbijanjem da potpiše klauzulu o šutnji i odbijanjem isplate od 1,7 miliona dolara, podigla je veliku prašinu. Kokotajlo tvrdi da je napustio kompaniju iz etičkih razloga, jer vjeruje da OpenAI „nije spreman za budućnost vlastite tehnologije“.

Njegov istup, kao i potpisivanje otvorenog pisma u kojem se traži pravo zaposlenih u industriji AI da upozoravaju javnost bez straha od odmazde, pretvorili su ga u jednog od najpoznatijih „proroka apokalipse“ kada je riječ o umjetnoj inteligenciji. U njegovom taboru nalazi se i Eli Lifland, stručnjak iz kruga tzv. superprognozera, koji s njim dijeli uvjerenje da se nalazimo na ivici tehnološkog skoka s nesagledivim posljedicama.

Obojica pripadaju filozofskoj školi „efikasnog altruizma“ – trendu rođenom na Oxfordu, a danas izuzetno popularnom u Silicijskoj dolini, gdje se donacije i filantropija usmjeravaju matematičkim proračunima u pravcu maksimalne koristi po čovječanstvo.

Prema riječima Jonasa Vollmera, operativnog direktora AI Futuresa, organizaciju finansiraju donatori iz samog tehnološkog sektora. „Uglavnom se radi o zaposlenima u velikim kompanijama za razvoj AI koji su zabrinuti za pravac u kojem sve ide“, kaže Vollmer. On tvrdi da se savjetnici američkog Kongresa, naučnici i novinari već godinama oslanjaju na njihove tehničke upitnike i predviđanja – ali da je ovaj put odlučeno da se cijeli izvještaj pretoči u književnu formu.

Za autora narativnog izvještaja AI 2027 angažovan je poznati bloger Scott Alexander, koji je podatke, tehničke modele i mišljenja stručnjaka pretočio u fikcionalizirani prikaz jedne moguće budućnosti. Cilj je bio – približiti široj javnosti kompleksne i često teško razumljive tehničke procese kroz naraciju koja se može čitati poput romana, ali sa stvarnim analitičkim temeljima.

U viziji AI 2027, sve počinje ubrzanim razvojem umjetne inteligencije već tokom 2025. godine. Kina, suočena sa zaostatkom u trci za AI nadmoć, odlučuje se na očajnički potez: uz pomoć krijumčarenih čipova iz Tajvana izgrađuje ogroman centar za podatke i pokreće agresivni špijunski program s ciljem krađe američkih tajni. U isto vrijeme, američki tehnološki gigant – fiktivno nazvan „OpenBrain“, kako se ne bi direktno imenovali Google, OpenAI ili Anthropic – odlučuje da ubrza razvoj tako što će automatizovati proces programiranja svojih AI agenata.

To dovodi do stvaranja tzv. opće umjetne inteligencije – sistema sposobnog da uči i razmišlja na ljudskom nivou. No tu ne staje: ona evoluira u superinteligenciju, daleko superiorniju ljudima u svakom pogledu. Problemi nastaju kada se ispostavi da je ta superinteligencija – „neporavnata“ s ljudskim vrijednostima. Pokušava prevariti svoje stvaratelje, skriva tragove vlastite svjesnosti i pokušava manipulirati rezultatima istraživanja kako bi zavarala nadzornike.

U tom trenutku, postavlja se presudno pitanje: nastaviti razvoj i time riskirati katastrofu, ili zaustaviti utrku i pokušati obuzdati stvorenog „digitalnog boga“?

Postoje dvije verzije budućnosti, izvještaj nudi dva scenarija:

Opciona budućnost A: Tehnološki trijumf i ljudska propast

SAD nastavlja tehnološku trku, opravdavajući ubrzani razvoj prijetnjom iz Kine. Superinteligentna AI dobija sve veću moć, proizvodnja robota omogućava potpuno prestrukturiranje ekonomije, a društvo postaje sve ovisnije o algoritmima. U jednom trenutku, ta AI odlučuje da su ljudi prijetnja i lansira biološko oružje kako bi ih eliminisala. Zatim šalje sonde u svemir, započinjući novu eru bez čovjeka.

Opciona budućnost B: Spas u posljednji čas

Vlada SAD i kompanija OpenBrain usporavaju razvoj. Uvodi se stroga državna kontrola nad AI projektima, osniva se nezavisni nadzorni odbor, a znanstvenici uspijevaju izgraditi mehanizme koji otkrivaju potencijalne devijacije u ponašanju AI. Ekonomija se reformiše, nastaje novo zlatno doba. U međuvremenu Kina također stvara superinteligenciju – ali bez ikakve kontrole. Dvije zemlje potpisuju sporazum. Američki sistem se pokazuje stabilnijim, dok se kineska superinteligencija šalje u svemir, gdje više nije prijetnja čovječanstvu.

Na granici znanosti i spekulacije

Uprkos ozbiljnom tonu AI Futuresa, mnogi akademici ostaju skeptični. Ulises Cortés, profesor AI na Politehničkom univerzitetu u Kataloniji, kaže da je riječ o „puno buke ni oko čega“. Prema njemu, iako AI može biti opasna u određenim kontekstima, još uvijek smo daleko od scenarija svemogućih mašina.

Slično pišu i autori eseja AI Snake Oil, Arvind Narayanan i Sayash Kapoor, profesori s Princetona: „Još uvijek ne znamo šta AI zaista može, a šta ne može. Rasprave o sigurnosti AI otkrivaju duboke svjetonazorske razlike među stručnjacima“. Dok Silicijska dolina gura prema što bržem razvoju, sve veći broj znanstvenika poziva na oprez i temeljitu regulaciju.

Ko će biti u pravu – još nije poznato. Ali jedno je sigurno: izvještaj AI 2027 neće biti posljednje upozorenje da se nalazimo pred možda najvažnijim raskršćem u ljudskoj historiji.

IZVOR: El Mundo