AI ne nadilazi predrasude, već pojačava orijentalističku i islamofobičnu moć predstavljajući je kao neutralno znanje

Središnji argument koji je Edward Said iznio u svojim studijama o orijentalizmu jest da je Istok transformiran iz subjekta sposobnog da se sam izražava u objekt koji Zapad predstavlja i interpretira. Ovaj odnos predstavljanja reproduciran je u širokom spektru domena, protežući se izvan akademskih tekstova u književnost, politiku, medije i svakodnevni jezik, formirajući na koncu kulturnu hegemoniju. Štoviše, ta je hegemonija toliko moćna da produkcija znanja o Istoku često ne može izaći izvan ovog okvira; a čak i kada uspije, teško pronalazi mjesto u glavnim tokovima.

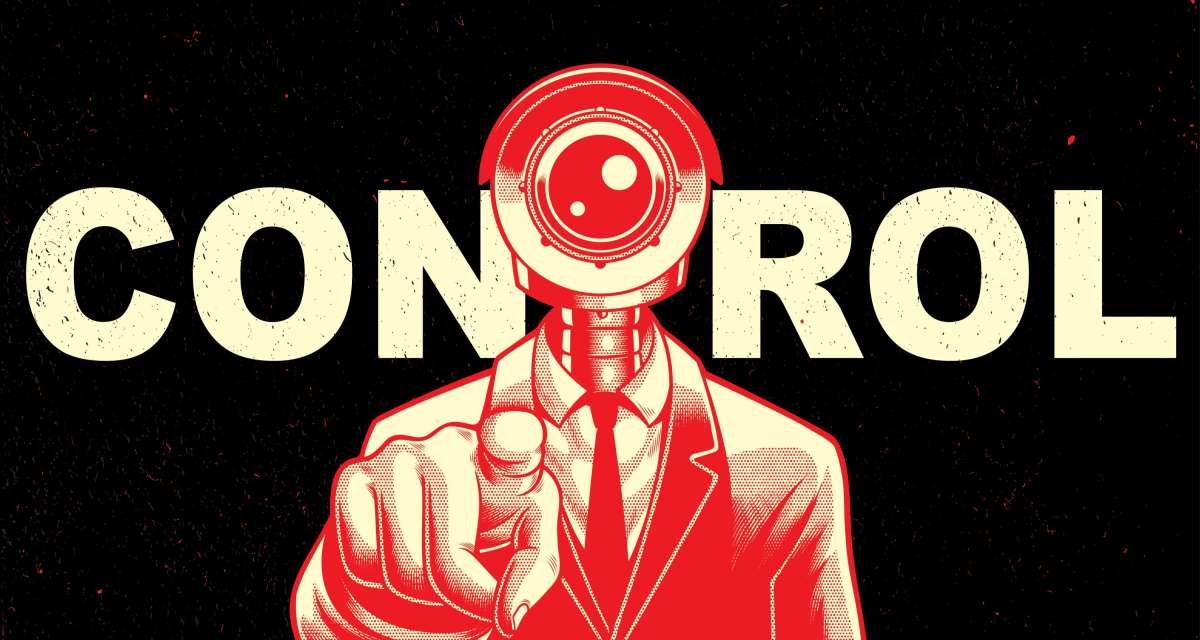

Orijentalistička hegemonija kontinuirano se osnažuje kroz tehnološki razvoj. Tragovi te hegemonije jasno su vidljivi na digitalnim platformama koje koristi velik dio populacije. Posebno u polju generativne umjetne inteligencije, brzo i rašireno usvajanje velikih jezičkih modela (LLM) od strane globalne publike transformiralo je orijentalističku retoriku, čineći je značajno moćnijom. Tako se, s usponom tehnologija generativne AI, čini da je ovaj režim predstavljanja ušao u novu fazu.

AI koristi prethodno proizvedeno znanje kao podatke za obuku (memoriju) i generira novi sadržaj na temelju tih skupova podataka. Međutim, ova “memorija” nije neutralna; naprotiv, ona odražava duboko ukorijenjene odnose moći i predrasude unutar društava. Iz tog razloga, AI ne stvara potpuno novi jezik, već reproducira postojeći zajedno s hijerarhijama koje su u njega ugrađene. To pokazuje da orijentalizam nije puki diskurs prošlosti, već da opstaje i u digitalnom dobu u nevidljivijem ali učinkovitijem i moćnijem obliku.

Reprodukcija orijentalističkih načina predstavljanja putem umjetne inteligencije ne manifestira se samo na tekstualnoj razini, već i na vizualnoj i konceptualnoj. Kao što je naglašeno u prethodnim radovima, prikazi koje proizvode modeli “text-to-image”, često homogenizirajući Južnu Aziju, egzotizirajući je i učestalo je povezujući sa siromaštvom, pružaju konkretan primjer ovog fenomena. Umjesto da odražavaju stvarnost, ovi prikazi ponovno stavljaju u optjecaj perspektive usađene u skupove podataka oblikovane zapadnocentričnim pogledom. Slično tome, prikazivanje muslimana pretežno kroz kontekste terorizma, straha i sigurnosti odražava isti obrazac.

Najkritičnije pitanje koje se ovdje javlja jest sposobnost AI-ja da te prikaze predstavi kao prirodno i neutralno znanje. Drugim riječima, sadržaj koji generira AI teži da bude percipiran kao objektivniji i pouzdaniji upravo zato što je proizveden kroz algoritamski proces. To zauzvrat omogućuje predrasudama da postanu dublje ukorijenjene i teže za osporavanje. Posljedično, epistemički autoritet koji je nekada građen kroz akademiju, kulturne sfere i medije, sada se rekonstruira kroz algoritamske sustave.

Iz tog razloga, potreba za sveobuhvatnim istraživanjem o postojanju, razmjerima i dimenzijama problema je očita. Međutim, studije u ovom području ostaju ograničene i tek se počinju pojavljivati. U tom kontekstu, nedavna studija Bakhta Munira projicira odnos između AI i islamofobije. Nalazi studije jasno pokazuju da odnos između AI i društvenih predrasuda nije površan, već dubok i strukturne prirode.

Jedan od najznačajnijih doprinosa studije je njezini napor da definira koncept islamofobične AI. Ovaj koncept nastoji sistematizirati polje koje još nije jasno razgraničeno u literaturi, objašnjavajući kako se religijske predrasude manifestiraju u kontekstu AI. Studija pristupa fenomenu islamofobične AI ne samo kao tehničkom pitanju, već unutar njegovih povijesnih, pravnih i društvenih konteksta. Ova perspektiva je posebno dragocjena jer locira izvor predrasuda ne samo u samim algoritmima, već i u ekosustavima podataka koji ih hrane te, šire, u strukturi društva.

Dobro je poznato da su skupovi podataka korišteni za obuku AI modela povijesno prožeti religijskim, rasnim i rodnim predrasudama, te da AI stoga reproducira te pristranosti. Studija se bavi ovim predrasudama u kontekstu islamofobije kroz teorijske i empirijske primjere. Posebno primjeri izvučeni iz pravnog sustava SAD-a pokazuju da se pristranost proizvodi ne samo na individualnoj razini, već i na institucionalnoj i sistemskoj.

Širok raspon predstavljenih primjera, od slučaja Dred Scott do Plessy protiv Fergusona, te od zabrana putovanja do politika nadzora, otkriva da skupovi podataka koji čine “memoriju” AI-ja nisu neutralni, već oblikovani povijesnim akumulacijama koje muslimane dosljedno povezuju s protupravnim djelovanjem.

Stoga, tendencija AI sustava da povezuju muslimane s nasiljem, terorizmom i sigurnosnim prijetnjama nije tehnička pogreška; ona odgovara kontinuitetu šire povijesne akumulacije orijentalističke hegemonije kroz AI tehnologije. To je zato što se AI skupovi podataka hrane širokim spektrom izvora, uključujući medijski diskurs, političke odluke, akademske studije i pravne tekstove. Značajan dio tih izvora oblikovan je , osobito u razdoblju nakon 11. septembra, narativima usmjerenim na sigurnost.

Odraz elemenata kao što su sudske presude, politike nadzora, diskriminatorni zakoni i medijski narativi u skupovima podataka stvara uvjete da AI sustavno reproducira te predrasude. Stoga ne iznenađuje da AI modeli obučeni u takvom ekosustavu podataka repliciraju slične obrasce. Ono što je ovdje posebno upečatljivo jest da te predrasude više nisu ograničene na tekstove, već su postale ugrađene u algoritamske procese donošenja odluka. To dokazuje da je algoritamska pristranost, zapravo, produžetak šire društvene pristranosti.

Nalazi studije također jasno otkrivaju ograničenja pristupa tehničkim rješenjima. Iako se priznaje da različite metode, poput finog podešavanja, učenja iz ljudskih povratnih informacija i metrika pravednosti, mogu biti učinkovite u smanjenju pristranosti, studija naglašava da te metode ne mogu u potpunosti eliminirati predrasude. Glavni razlog tome je što se implicitne i strukturne pristranosti ugrađene u skupove podataka ne mogu potpuno razmrsiti samo tehničkim alatima.

U ovoj točki, jedan od najupečatljivijih argumenata članka je da pristranost nije samo tehnički problem, već i društveni. Stoga, transformacija skupova podataka zahtijeva ne samo poboljšanje algoritama i podataka, već i transformaciju društvenih struktura koje te podatke proizvode. Drugim riječima, ako skupovi podataka odražavaju društvenu stvarnost, a ta je stvarnost oblikovana predrasudama, tada eliminacija tih predrasuda zahtijeva više od ispravljanja algoritama, ona zahtijeva rješavanje društvenih struktura koje generiraju same podatke.

Odnos između AI, orijentalizma i islamofobije i problemi koje on proizvodi ne bi se trebao shvatiti kao tehnički kvar, već kao tehnološka manifestacija i nastavak zapadne epistemologije. Umjetna inteligencija nasljeđuje akumulirano naslijeđe orijentalističke misli i reproducira ga u mnogo većim razmjerima. To transformira AI iz običnog alata u pristrani epistemički autoritet. Ako se ovi procesi kritički ne ispitaju, AI će ne samo reproducirati postojeće predrasude, već će ih učiniti nevidljivijima i značajno moćnijima. Iz tog razloga, ovo pitanje zahtijeva dublje preispitivanje o tome kakva se vrsta znanja proizvodi putem ovih alata, kako se ono proizvodi i u čije ime ti sustavi na koncu govore.

Mahmut Özer je bivši ministar obrazovanja Republike Turske i zastupnik Stranke pravde i razvoja (AK Parti); ovaj komentra je napisao za Daily Sabah